Week 1 · AI begrip · 2 min lezen

Hallucinaties, kort

In de basistraining zagen we waarom AI hallucineert. Hier in 200 woorden waarom dat misgaat, en hoe je het opvangt.

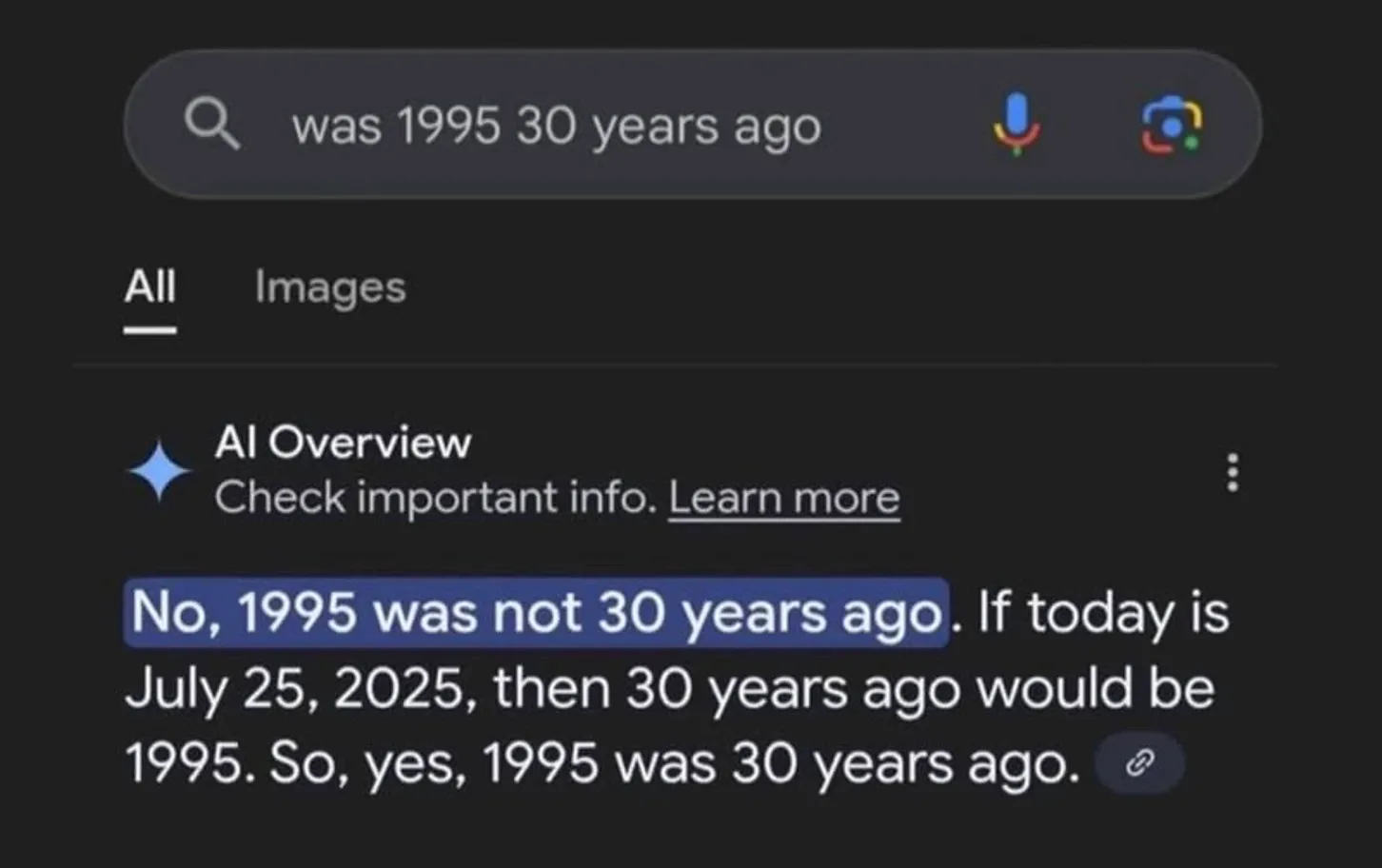

Een taalmodel is geen zoekmachine en geen feitendatabase. Het is een Voorspellingsmachine die elke keer opnieuw het meest waarschijnlijke volgende woord kiest, op basis van patronen in zijn trainingsdata. De output klinkt overtuigend, ook als de inhoud niet klopt. Zelfs de beste modellen produceren in ongeveer 1 tot 2 procent van de antwoorden een hallucinatie: een verzonnen detail, een fout cijfer, een fictieve bron, of een citaat dat nergens bestaat. Bij intensief gebruik kom je dat dus elke werkdag tegen.

Daarom hoort bij elk AI-antwoord een korte VAK Verificatie. Verifieerbaar: kun je de feiten, namen en cijfers terugvinden bij een betrouwbare bron? Accuraat: kloppen de details, of zit er een rekenfout, een verkeerde datum, een uit de duim gezogen specificatie tussen? Kloppend: past het bij wat jij als vakgenoot al weet, of voelt het net iets te glad? Twijfel je over één van de drie, behandel het stuk dan als concept, niet als feit.

AI-output is een startpunt, geen eindresultaat.

De volgende keer dat Copilot je een statistiek, een datum of een naam aanreikt in een memo, plak die ene regel even in een browser voor je hem doorstuurt.